보안 SW업체 맥아피, CES서 공개

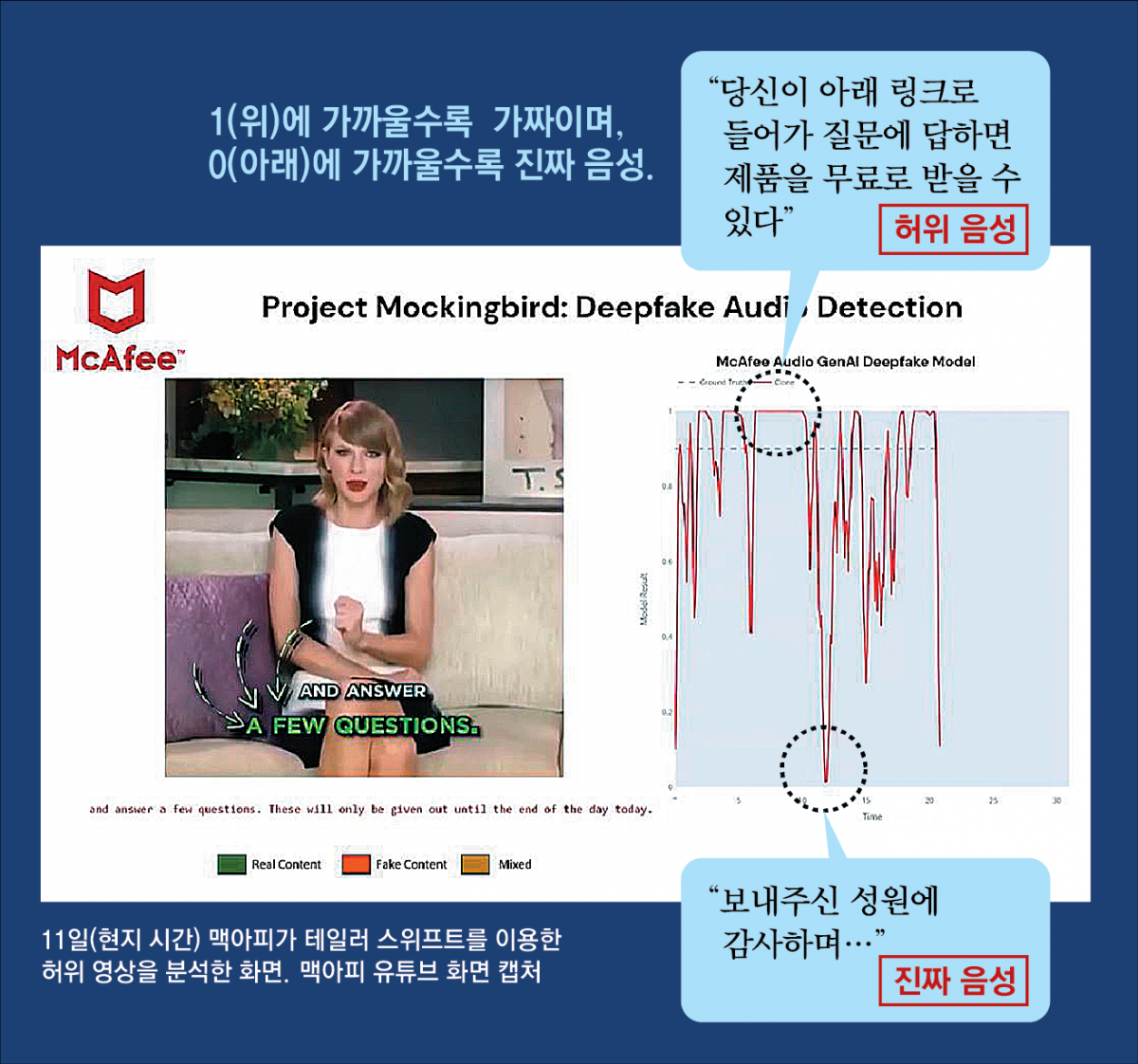

논란 부른 스위프트 영상 진위 분석… “사람 행동-맥락-음역 분석해 판단”

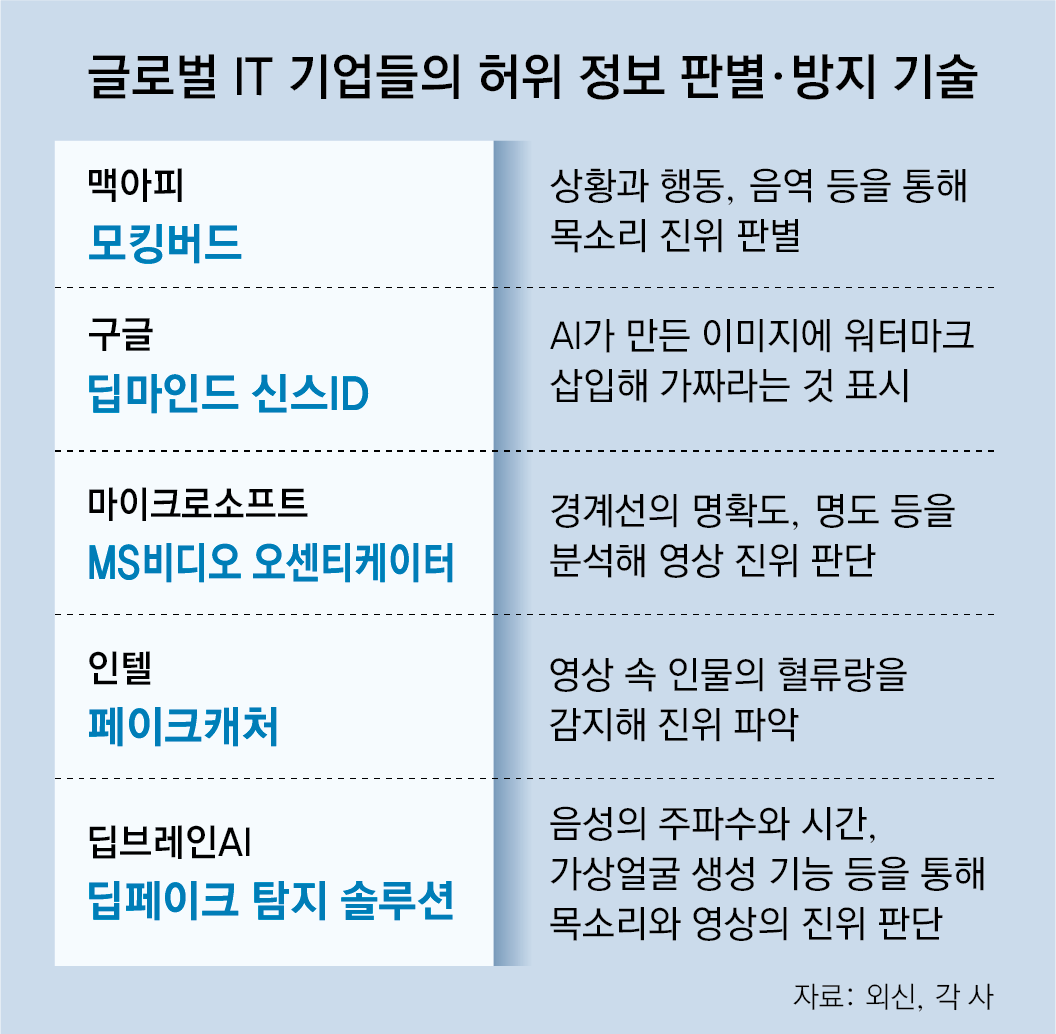

빅테크들도 허위 정보와의 전쟁… AI이미지 인증 도장-딥페이크 감지

“테일러 스위프트입니다. 포장 문제로 못 팔게 된 3000개 르쿠르제(프랑스 주방용품 브랜드) 조리기구 세트를 팬 여러분께 무료로 드리려 합니다. 광고를 누르고 질문에 답해주세요.”

최근 소셜네트워크서비스(SNS)에서 테일러 스위프트가 출연한 광고 영상이 논란이 됐다. 인공지능(AI)으로 조작한 가짜 목소리 ‘딥보이스’인 것으로 판명 났기 때문이다. 이 영상엔 실제 목소리와 조작된 목소리가 섞여 있었지만 일반인의 귀로는 구분하기가 매우 어렵다.

12일(현지 시간) 폐막하는 세계 최대 정보기술(IT)·가전 전시회 CES 2024에서는 AI의 부작용을 막기 위한 AI 기술이 주목받았다. 미국 대선을 앞두고 딥보이스 및 AI로 조작된 가짜 영상 ‘딥페이크’ 등에 대한 우려가 커지는 데다 보이스피싱 등 범죄로도 악용되고 있어 글로벌 IT 업체들이 진위를 판별하거나, 조작을 방지하는 기술을 개발하는 것이다.

모킹버드는 말하는 사람의 행동과 상황적 맥락, 음역과 사용된 언어 범주 등을 분석해 음성의 진위를 판단하고 결과를 그래프로 보여준다. 진짜 목소리에 가까울수록 0, 가짜 음성으로 판단될수록 1에 가까워진다. 스위프트 허위 광고 속 목소리는 한 문장 속에서도 진짜와 가짜가 섞여 있어 그래프가 들쭉날쭉 요동 치는 형태를 보였다.맥아피 측은 “90%의 정확도로 AI가 만든 가짜 목소리를 탐지할 수 있다”고 밝혔다.

이와 관련해 맥아피가 지난해 12월 설문조사를 한 결과, 미국인의 84%가 딥페이크의 악용을 우려하고 있는 것으로 나타났다. 특히 응답자의 52%는 딥페이크가 선거에 영향을 미치고, 미디어에 대한 신뢰를 훼손하고(48%), 공인을 사칭하는 데 사용될 것(49%)이라고 우려했다.

스티브 그로브먼 맥아피 최고기술책임자(CTO)는 “딥페이크를 탐지하는 AI 기술의 사용 사례는 광범위할 것”이라며 “소비자가 ‘칩페이크’(짧은 시간과 적은 노력을 들여 위·변조하는 것) 사기를 피할 수 있도록 돕고, (미 대선에서) 대통령 후보 영상의 진위를 즉각 알 수 있도록 할 것”이라고 말했다.

마이크로소프트(MS)는 딥페이크 여부를 탐지하는 ‘MS비디오 어센티케이터’를 발표했다. 사람의 턱과 같은 경계선에서 흐릿함의 정도와 명도 등을 통해 진위를 판단하는 기술이다. 이를 기반으로 영상에 대한 신뢰 점수를 부여한다.

국내 기업 중에서는 딥브레인AI가 지난해 가짜 음성 및 영상 탐지 솔루션을 내놨다. 음성의 주파수와 시간 등을 고려해 음성 합성 및 조작 여부를 판단하고, 자사의 가상 얼굴 생성 기능, 특정인의 얼굴로 교체하는 기능 등을 활용해 조작된 영상인지를 판단하는 기술이다. 12일에는 공간의 제약에서 벗어나 클라우드 환경에서도 운영할 수 있는 솔루션을 추가했다.

구글의 AI 개발조직 딥마인드는 AI로 생성된 이미지에 ‘꼬리표’를 달아 악용을 막기 위한 기술 ‘딥마인드 신스ID’를 내놨다. 이미지에 육안으로 식별할 수 없는 워터마크를 삽입하는 방식이다. 사람의 눈에는 보이지 않는 워터마크이기 때문에 이를 편집해서 없애기 쉽지 않다. 가짜임을 알려주는 표시를 남기는 기술인 셈이다.

-

- 좋아요

- 0개

-

- 슬퍼요

- 0개

-

- 화나요

- 0개

-

- 추천해요

- 개

댓글 0