“개인정보 유출 우려” 46% 응답

63%는 “알고리즘 선별기준 공개를”

“생성형AI 이용한 적 있다” 12%

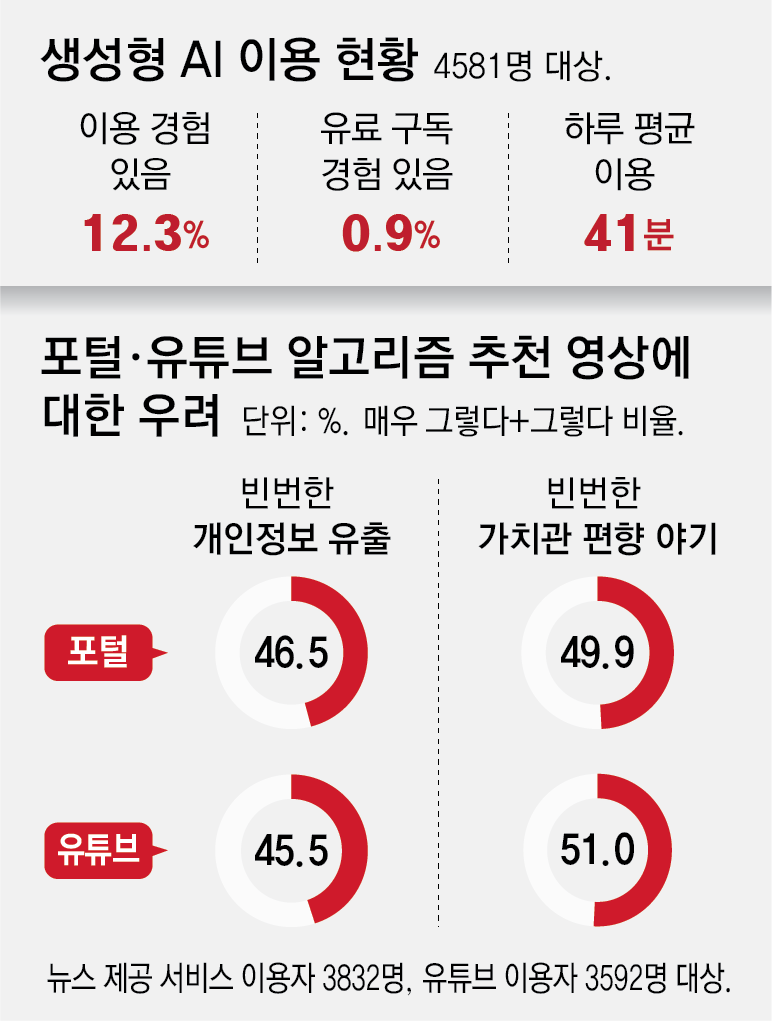

지난해 유튜브 한국 이용자의 절반가량은 알고리즘 추천 동영상이 편향적 사고를 갖게 만든다고 우려하는 것으로 나타났다. 또 알고리즘으로 인해 개인정보 유출 우려가 크다고 걱정하고 있었다. 10명 중 6명은 알고리즘 기준 공개가 필요하다고 생각하고 있었다.

20일 방송통신위원회와 정보통신정책연구원은 인공지능(AI), 사물인터넷 등 지능정보 기술과 서비스에 대한 이용자 인식 등을 조사한 ‘2023년 지능정보사회 이용자 패널조사’ 결과를 발표했다. 이번 조사는 스마트폰을 이용하면서 하루 1회 이상 인터넷을 이용하는 전국 4581명(만 16∼69세)을 대상으로 진행됐다.

조사 결과 포털과 유튜브에서 제공하는 알고리즘 추천 서비스에 대해 전반적으로 취향에 잘 맞춰져 있으며(포털 68.9%, 유튜브 71.2%), 앞으로도 지속적으로 이용할 의향(포털 68.3%, 유튜브 68.5%)이 있다는 답변이 많았다.

응답자들은 추천 알고리즘 서비스 제공자가 준수해야 할 윤리적 책무로 ‘알고리즘의 콘텐츠 선별 기준 공개’(62.9%)를 가장 많이 꼽았다.

생성형 AI 이용 경험에 대한 조사에서는 응답자의 12.3%가 이용해 본 적이 있다고 답했다. 텍스트 생성(81.0%) 이용 비율이 가장 높았고, 음성·음악 생성(10.5%), 도메인 이미지 생성(4.8%), 이미지 생성(3.6%) 순이었다.

챗GPT가 출시된 지 1년이 조금 지난 시점임을 감안하면 이용 경험이 단기간에 확산했다는 것이 방통위의 설명이다. 일평균 이용 시간은 41분이고, 유료 구독 경험이 있는 사람은 0.9% 수준에 그쳤다.

-

- 좋아요

- 0개

-

- 슬퍼요

- 0개

-

- 화나요

- 0개

-

- 추천해요

- 개

![흐리고 중부엔 비…추위 누그러진 늦가을[날씨]](https://dimg.donga.com/a/464/260/95/1/wps/NEWS/FEED/Donga_Home_News/130467715.1.thumb.jpg)

![“생후 2개월 아기 밤낮 돌보며 청소·빨래까지”…‘월 300만원’ 구인 공고 논란 [e글e글]](https://dimg.donga.com/a/464/260/95/1/wps/NEWS/FEED/Donga_Home_News/130467919.4.thumb.jpg)

댓글 0